V-JEPA 2

1. サービス概要

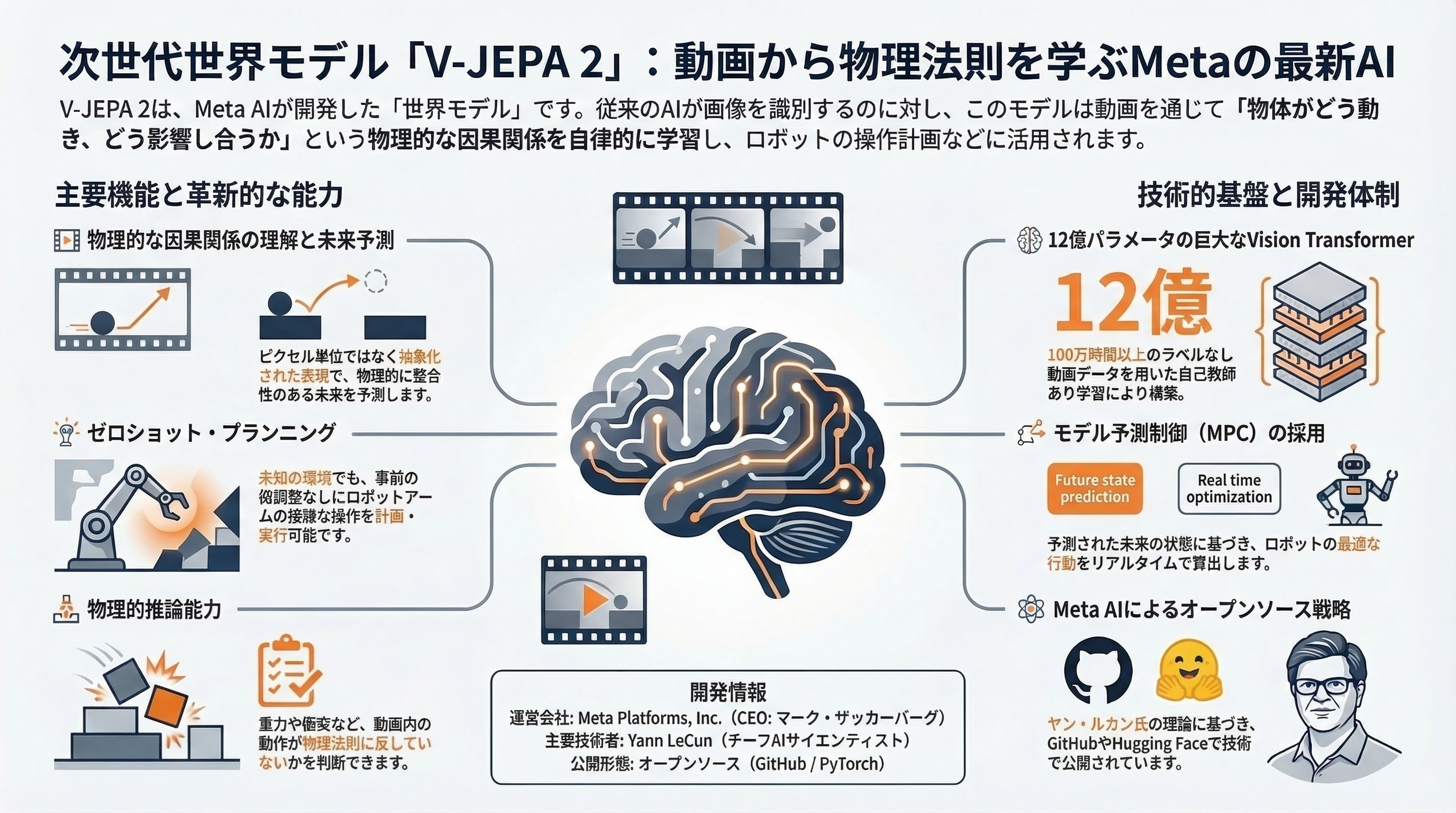

「V-JEPA 2」は、Meta(旧Facebook)のAI研究部門であるMeta AIが開発した、動画を通じて物理世界を理解・予測する世界モデル(World Model)です。従来のAIが「画像に何が映っているか」を識別するのに対し、V-JEPA 2は「物体がどのように動き、周囲にどのような影響を与えるか」という物理的因果関係を学習します。

- 主な機能:

- 高次元表現での未来予測: ピクセル単位ではなく、抽象化されたベクトル空間で未来の状態を予測することで計算コストを抑えつつ、物理的な整合性を維持。

- ゼロショット・プランニング: 未知の環境や物体に対しても、事前の微調整なしでロボットアームの操作(把持、配置など)を計画・実行可能。

- 物理的推論: 動画内の動作が物理法則(重力、衝突など)に反していないかを判断する能力。

- ユーザー数: 研究者・開発者向けにモデルがオープンソース公開されており、具体的な一般利用者数は未公表。

- 対応プラットフォーム:

- GitHub: ソースコードと学習スクリプトが公開。

- PyTorch: 実装のベースフレームワーク。

- Hugging Face / Facebook Collection: モデル重みの配布。

2. 使用している技術スタック

V-JEPA 2 は、Metaが提唱する「JEPA(Joint-Embedding Predictive Architecture)」に基づき構築されています。

- アーキテクチャ:

- Vision Transformer (ViT-g): 最大約12億(1.2B)パラメータの巨大なエンコーダを採用。

- 自己教師あり学習 (Self-Supervised Learning): ラベルのない100万時間以上の動画データから、欠損したフレーム(マスク部分)を予測することで学習。

- 制御アルゴリズム:

- MPC (Model Predictive Control / モデル予測制御): 予測された未来の状態に基づき、ロボットの最適な行動列をリアルタイムで算出。

- 開発・実行環境:

- 言語: Python

- フレームワーク: PyTorch

- 学習データ: インターネット上の大規模動画データ、およびFrankaロボットアームの動作データ(約62時間分)。

3. 会社概要

- 運営会社名: Meta Platforms, Inc.(メタ・プラットフォームズ)

- 設立年: 2004年2月4日(Facebook, Inc.として設立、2021年に社名変更)

- 本社所在地: 1 Meta Way, Menlo Park, CA 94025, USA(アメリカ合衆国カリフォルニア州メンローパーク)

- 従業員数: 約67,317人(2023年12月末時点。※2026年現在の最新推計では変動あり、約7万人規模)

4. 沿革、資本構成、国籍、役員情報

- 沿革:

- 2004年:マーク・ザッカーバーグらがハーバード大学で「TheFacebook」を開始。

- 2012年:NASDAQ市場に上場。Instagramを買収。

- 2014年:WhatsApp、Oculus VRを買収。

- 2021年:メタバース企業への転換を目指し「Meta」へ社名変更。

- 2024-25年:LlamaシリーズやV-JEPAなど、AI分野への巨額投資と技術公開を加速。

- 資本構成:

- 米国NASDAQ市場上場の公開企業(ティッカー:META)。

- 二層構造の株式(クラスA・クラスB)を採用しており、創業者マーク・ザッカーバーグが強力な議決権(支配権)を保持している。

- 国籍: アメリカ合衆国

- 役員情報(主要メンバー):

- Mark Zuckerberg(会長兼CEO): アメリカ国籍。ハーバード大学中退。創業以来の経営トップ。

- Susan Li(CFO): アメリカ国籍。スタンフォード大学卒。モルガン・スタンレーを経て2008年からMetaに在籍。

- Andrew Bosworth(CTO): アメリカ国籍。ハードウェア部門(Reality Labs)を率い、AI戦略も統括。

- Yann LeCun(チーフAIサイエンティスト): フランス/アメリカ国籍。ディープラーニングの先駆者。V-JEPA 2の理論的基礎であるJEPAの提唱者。