要旨

Metaが自社開発AI半導体「MTIA」シリーズの4世代にわたるロードマップを公開した。MTIA 300(量産中)、400「Iris」(ラボテスト段階)、450「Arke」、500「Astrid」の4チップを約6ヶ月ごとにリリースする。RISC-VアーキテクチャをベースにBroadcomとTSMCと協業し、生成AI推論に特化した設計でNvidia GPU依存からの脱却を図る。ただし学習用途では引き続きNvidia Blackwellを使用し、これは「置き換え」ではなく「多様化」の戦略である。

本文

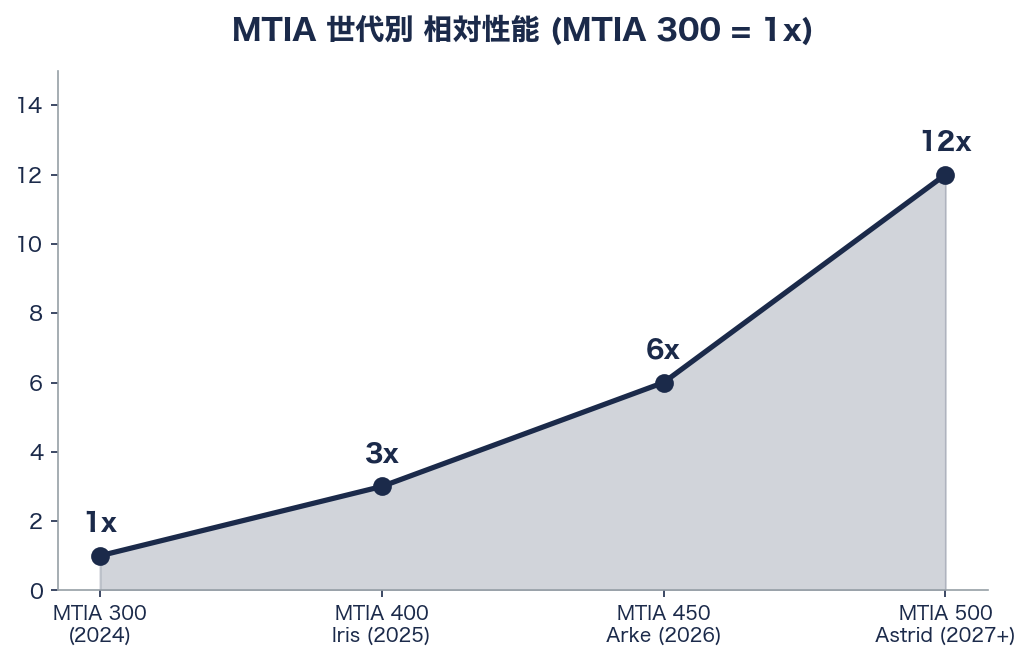

Metaは2026年3月19日、自社開発のAI推論チップ「MTIA」(Meta Training and Inference Accelerator)の包括的なロードマップを発表した。MTIA 300、400「Iris」、450「Arke」、500「Astrid」の4世代を、約6ヶ月のリリースサイクルで順次投入する計画である。各世代にコードネームが付与されたことは、Metaがこのチップラインを一時的な実験ではなく、長期的な事業基盤として位置づけていることを示唆する。

MTIA 300――量産段階に入った第1世代

最初のモデルであるMTIA 300はすでに量産段階に入り、Meta社内のデータセンターで実稼働している。Facebook、Instagram、WhatsAppといった主力サービスでの生成AI推論ワークロードを処理しており、ワットあたりの性能でNvidia GPUを上回るとMetaは主張している。数十億ユーザーにAIサービスを提供するMetaにとって、推論コストの最適化はインフラ支出に直結する最重要課題である。

MTIA 400「Iris」――商用製品と競合する初の自社チップ

現在ラボテスト段階にあるMTIA 400「Iris」は、Metaにとって重要なマイルストーンとなる。同社はこのチップを「生の性能(raw performance)において市場をリードする商用製品と競合し得る初のチップ」と位置づけている。つまり、MTIA 300が「自社ワークロード最適化によるコスト効率」を武器としていたのに対し、Irisは絶対性能でもNvidiaのGPUに匹敵する水準を目指しているということだ。

MTIA 450「Arke」――帯域幅の倍増

MTIA 450「Arke」では、HBM(High Bandwidth Memory)帯域幅がMTIA 400比で倍増される。Metaはこの帯域幅を「既存の市場リーディング製品をはるかに超える(much higher than existing leading commercial products)」と表現しており、大規模言語モデルの推論においてメモリ帯域幅がボトルネックとなる問題を根本的に解消する狙いがある。生成AIの推論では、モデルの重みデータを高速にメモリからロードする必要があり、帯域幅の拡大は直接的な推論速度の向上に繋がる。

MTIA 500「Astrid」――ロードマップの集大成

ロードマップの最終世代であるMTIA 500「Astrid」の詳細はまだ限定的だが、Arkeで確立された高帯域幅アーキテクチャをさらに進化させるものとされている。Metaが6ヶ月ごとのリリースサイクルを維持できれば、Astridは2027年後半から2028年初頭に登場する計算になる。

技術基盤――RISC-V、Broadcom、TSMC

技術面では、MTIAシリーズはRISC-Vアーキテクチャを採用している。RISC-Vはオープンソースの命令セットアーキテクチャ(ISA)であり、ライセンス料が不要でカスタマイズ性が高い。ArmベースのチップやNvidiaのCUDAエコシステムに縛られない独自の設計を可能にする。チップの製造はTSMCが担当し、設計においてはBroadcomとの深い協業関係が構築されている。6ヶ月ごとの新世代リリースという積極的なサイクルは、Nvidiaの年次リリースサイクルよりも速い。

推論特化の戦略的意味――「多様化」であり「置き換え」ではない

重要なのは、MTIAが学習(トレーニング)ではなく推論(インファレンス)に焦点を当てている点だ。AIモデルの学習には依然としてNvidiaのBlackwell世代GPUが使用されており、Metaは今後もNvidiaおよびAMDからGPUを購入し続ける。MTIAは「Nvidia置き換え」ではなく「多様化(diversification)」の戦略であり、推論ワークロードの一部を自社チップに移行することでサプライヤー依存リスクの低減とコスト最適化を同時に追求する。

この「多様化」アプローチはMeta固有のものではない。GoogleはTPU(Tensor Processing Unit)で学習・推論の両方をカバーし、AmazonはTrainiumで学習、Inferentiaで推論を自社チップ化している。MicrosoftもMaiaチップを開発中だ。ハイパースケーラー各社が自社AI推論チップの開発に注力するトレンドは明確であり、Nvidia GPUへの一極依存からの脱却は業界全体の方向性となっている。

業界への影響

MetaのMTIAロードマップは、Nvidia支配のAI半導体市場に構造的な変化をもたらす可能性がある。Google(TPU)、Amazon(Trainium/Inferentia)、Microsoft(Maia)に続き、Metaが本格的な自社チップ戦略を展開することで、ハイパースケーラーにおけるNvidia GPU調達の比率は中長期的に低下する見通しだ。

RISC-Vの採用は半導体業界全体にとっても重要な転機である。AI推論チップという大量需要のカテゴリでRISC-Vが採用されることで、同アーキテクチャのエコシステムが加速度的に成長する可能性がある。

ただしリスクもある。自社チップ開発には膨大な投資が必要であり、AIモデルのアーキテクチャが急速に進化する中で、ハードウェアが陳腐化するリスクは常に存在する。Metaが6ヶ月サイクルという野心的なロードマップを実際に維持できるかどうかが、この戦略の成否を分ける鍵となる。

参考情報: Meta AI半導体チーム発表, RISC-V International動向, AI推論市場分析レポート, Google TPU・Amazon Trainium比較データ