Vellum

公式サイト

1. サービス概要

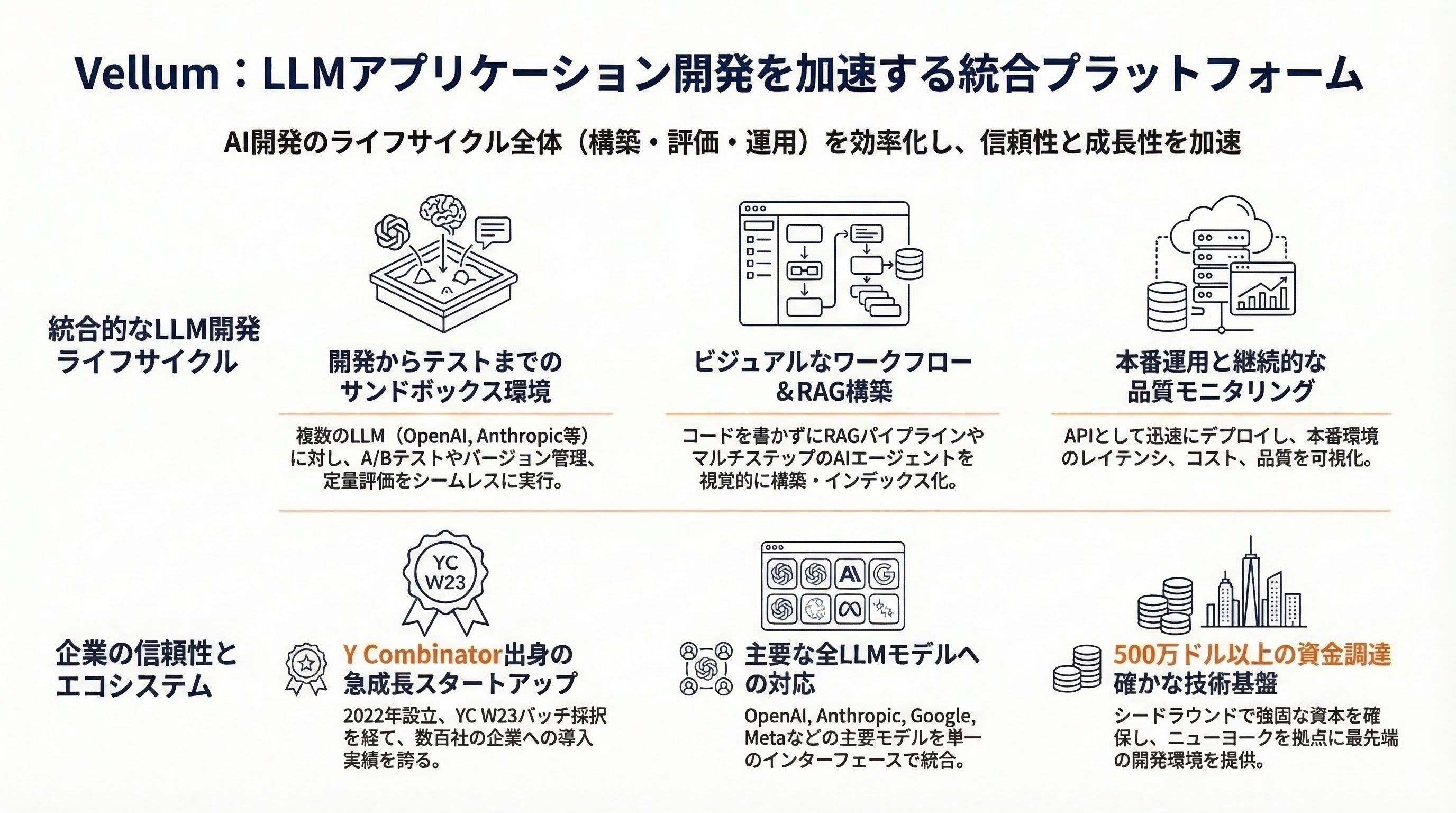

Vellumは、プロダクションレベルのAIアプリケーションを構築・運用するための統合LLM開発プラットフォームです。プロンプトエンジニアリング、テスト・評価、デプロイメント、モニタリングまでのライフサイクル全体をカバーし、エンジニアリングチームがRAGパイプラインやAIエージェントを効率的に開発・反復改善できる環境を提供します。

- 主な機能:

- プロンプトエンジニアリング: 複数のLLMに対してプロンプトのA/Bテスト、バージョン管理、最適化を行うサンドボックス環境。

- ワークフロービルダー: RAGパイプラインやマルチステップのAIワークフローをビジュアルに構築。条件分岐、ループ、サブワークフローに対応。

- 評価・テスト: テストケースに基づくプロンプトの定量評価。回帰テスト、ベンチマーク比較が可能。

- ドキュメントインデックス: RAG用のドキュメント管理。チャンク分割、埋め込み生成、検索インデックスの自動構築。

- デプロイメント: ワークフローをAPIとして本番環境にデプロイ。バージョン管理とロールバック機能。

- モニタリング: 本番環境でのLLM呼び出しのログ、レイテンシ、コスト、品質を可視化。

- ユーザー数:

- 数百社のスタートアップおよびエンタープライズ企業が導入(2025年時点)。

- 対応プラットフォーム:

- クラウド版(SaaS)として提供。

- Python/TypeScript SDKおよびREST APIに対応。

2. 使用している技術スタック

Vellumはモダンなクラウドネイティブアーキテクチャで構築されたフルスタックプラットフォームです。

- フロントエンド: React, TypeScript

- バックエンド: Python (Django)

- データベース: PostgreSQL

- ベクトルデータベース: 独自のベクトルインデックス管理(複数のベクトルストアに対応)

- LLM統合: OpenAI, Anthropic Claude, Google Gemini, Cohere, Meta Llama等の主要モデルに対応

- インフラ: AWS

- SDK: Python, TypeScript

3. 会社概要

Vellumは、AIアプリケーション開発のツーリング課題を解決するために設立されたニューヨーク拠点のスタートアップです。

- 運営会社名: Vellum AI, Inc.

- 設立年: 2022年

- 本社所在地: 米国ニューヨーク州ニューヨーク市

- 従業員数: 約20〜40名(推定、2025年時点)

4. 沿革、資本構成、国籍、役員情報

- 沿革:

- 2022年: Akash SharmaらがLLMアプリケーションの本番運用における課題を解決するプラットフォームとしてVellumを設立。

- 2023年冬: Y Combinator W23バッチに採択され、プロダクトの初期版をローンチ。

- 2023年: シードラウンドで500万ドル以上を調達。プロンプトエンジニアリングおよび評価機能を中心にプロダクトを拡充。

- 2024年: ワークフロービルダー、RAGパイプライン構築機能を追加。エンタープライズ顧客の獲得を加速。

- 2025年: エージェント型ワークフロー機能を強化。プロダクションAI開発のエンドツーエンドプラットフォームとしてのポジションを確立。

- 資本構成:

- Y Combinator W23バッチ出身。シードラウンドで500万ドル以上を調達。

- 投資家にはY Combinator、その他エンジェル投資家が含まれる。

- 国籍:

- 米国(デラウェア州法人)。

- 役員情報:

- Akash Sharma - CEO / 共同創業者:

- キャリア: ソフトウェアエンジニアリングおよびプロダクト開発のバックグラウンドを持つ。LLMの本番運用における課題を自ら経験し、Vellumを創業。

- 国籍: 米国

- Noa Mink - CTO / 共同創業者:

- キャリア: ソフトウェアエンジニアとしての豊富な経験を持ち、Vellumの技術基盤を構築。

- 国籍: 米国