Nexa AI

公式サイト

1. サービス概要

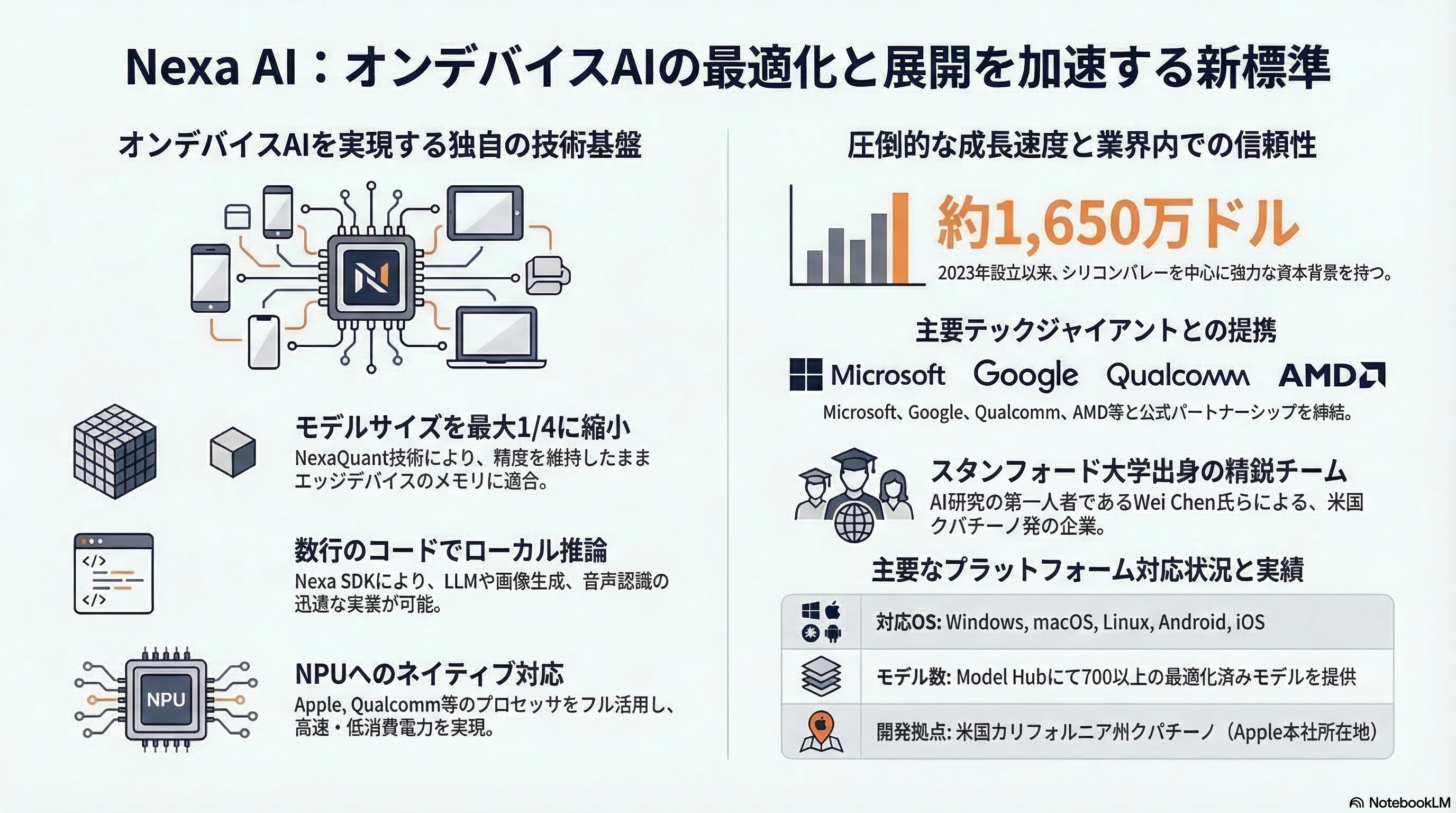

Nexa AI は、AI モデルをデバイス上で直接実行する「オンデバイス AI(エッジ AI)」の最適化と展開を支援するプラットフォームです。クラウドに依存せず、プライバシー保護、低遅延、通信コスト削減を実現することを目的としています。

- 主な機能:

- Nexa SDK: 数行のコードで様々な AI モデル(LLM、画像生成、音声認識等)をローカル環境で実行できる推論フレームワーク。

- モデル圧縮・量子化 (NexaQuant): 高精度を維持したまま、モデルサイズを最大 4 分の 1 に縮小し、モバイルやエッジデバイスのメモリ(RAM)に適合させる技術。

- Model Hub: 最適化済みの 700 以上の AI モデル(Llama、Gemma、Qwen 等)を提供。

- NPU へのネイティブ対応: Qualcomm、Apple、AMD、Intel 等のプロセッサに搭載された NPU(ニューラル・プロセッシング・ユニット)をフル活用し、高速・低消費電力な推論を実現。

- ユーザー数: 具体的な総ユーザー数は非公開(GitHub のスター数は 7,000 以上、提携先企業多数)。

- 対応プラットフォーム: Windows、macOS、Linux、Android、iOS。

2. 使用している技術スタック

Nexa AI は、クロスプラットフォームかつハードウェアアクセラレーションを最大化する構成をとっています。

- プログラミング言語: Python(API/SDK用)、C++(推論エンジン/ランタイム)、Swift(iOS用)、Kotlin(Android用)。

- 推論フレームワーク・ランタイム:

- NexaML: NPU 向けに最適化された独自の推論エンジン。

- llama.cpp / MLX: GGUF フォーマットや Apple Silicon に最適化されたライブラリの活用・統合。

- ハードウェア・バックエンド:

- Qualcomm: Hexagon NPU へのネイティブ対応。

- Apple: Apple Neural Engine (ANE) および Metal。

- NVIDIA: CUDA。

- AMD/Intel: 各社の NPU および GPU(Vulkan/DirectML等)。

- モデルフォーマット: GGUF、MLX、独自フォーマット(.nexa)。

3. 会社概要

- 運営会社名: NEXA AI, INC.

- 設立年: 2023年

- 本社所在地: 10133 Hillcrest Road, Cupertino, CA 95014, United States(カリフォルニア州クパチーノ)

- 従業員数: 約 31 名(2025年時点の推計値)

4. 沿革、資本構成、国籍、役員情報

- 沿革:

- 2023年2月:米国カリフォルニア州にて設立。

- 2024年4月:関数呼び出しに特化したオンデバイスモデル「Octopus v2」を発表し、Hugging Face 等で大きな注目を集める。

- 2024年8月:シリーズ A ラウンドにて 875 万ドル(約 13 億円)を調達。

- 2025年:Microsoft、Qualcomm、AMD、Google 等の主要チップ・プラットフォームベンダーと公式パートナーシップを締結。

- 資本構成: 非公開(外部資本として、Plug and Play Tech Center 等のベンチャーキャピタルが参加)。累計調達額は約 1,650 万ドル。

- 国籍: 米国

- 役員情報:

- Wei Chen (CEO): スタンフォード大学出身。オンデバイス AI および AI エージェントの研究に従事。中国系米国人。

- Zhiyuan Li (CTO): スタンフォード大学出身。大規模言語モデル (LLM) やマルチモーダルモデルの軽量化・高速化を専門とする。中国系米国人。

- Paul Smith (Co-Founder): 共同創設者の一人。CEO 職を担う場合もあり、主にビジネス展開を主導。米国籍。